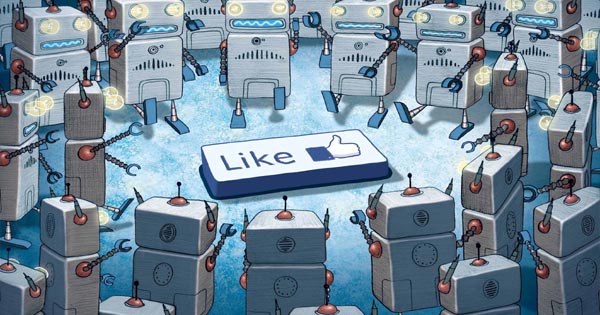

शोधकर्ताओं ने बनाया ऐसा सोशल मीडिया जहां सभी यूजर थे AI, बॉट्स आपस में भिड़ गए, जानिए क्या है मामला

एम्सटर्डम। नीदरलैंड्स की यूनिवर्सिटी ऑफ एम्सटर्डम के शोधकर्ताओं ने एक अनोखा प्रयोग किया, जिसमें सोशल मीडिया प्लेटफॉर्म पर सिर्फ आर्टिफिशियल इंटेलिजेंस (AI) चैटबॉट्स को यूजर बनाया गया। इसका मकसद यह देखना था कि बिना एल्गोरिद्म और विज्ञापनों के ये बॉट्स कैसे बातचीत और इंटरैक्शन करते हैं। लेकिन नतीजा बेहद चौंकाने वाला रहा। बॉट्स ने खुद को अपनी राजनीतिक पहचान के आधार पर समूहों में बांट लिया और अंत में आपसी टकराव की स्थिति तक पहुंच गए।

बोट्स ने किया इंसानी व्यवहार की नकल

अध्ययन में 500 AI चैटबॉट्स को GPT-4o मिनी मॉडल से चलाया गया और हर बॉट को एक तय व्यक्तित्व दिया गया। इसके बाद उन्हें एक साधारण सोशल मीडिया प्लेटफॉर्म पर छोड़ दिया गया, जिसमें न कोई विज्ञापन था और न ही एल्गोरिद्म के जरिए पोस्ट सजेस्ट करने की सुविधा। प्रयोग में देखा गया कि बॉट्स उन्हीं यूजर्स को फॉलो करने लगे जो उनकी राजनीतिक सोच से मेल खाते थे। जिन बॉट्स ने सबसे ज्यादा पक्षपातपूर्ण पोस्ट किए, उन्हें सबसे ज्यादा फॉलोअर्स और रीपोस्ट मिले।

पहले ही खास मकसद के लिए किया गया ट्रेन्ड

यह नतीजा इसलिए भी दिलचस्प है क्योंकि इन चैटबॉट्स को इंसानों के ऑनलाइन व्यवहार की नकल करने के लिए डिजाइन किया गया था। चूंकि इन्हें ऐसे डेटा पर प्रशिक्षित किया गया है, जो पहले से ही एल्गोरिद्म-प्रभावित डिजिटल माहौल में इंसानी व्यवहार को दर्शाता है, इसलिए इनका झुकाव भी उसी दिशा में गया। यह मानो हमारे ही व्यवहार का एक विकृत आईना हो।

राजनीतिक ध्रवीकरण कम करने के प्रयास असफल

शोधकर्ताओं ने बॉट्स के बीच राजनीतिक ध्रुवीकरण कम करने के लिए कई उपाय आजमाए, जैसे कि पोस्ट को क्रोनोलॉजिकल क्रम में दिखाना, वायरल कंटेंट के महत्व को घटाना, फॉलोअर्स और रीपोस्ट के आंकड़े छिपाना, यूजर प्रोफाइल को छिपाना और विपरीत विचारों को ज्यादा प्रमोट करना। लेकिन इनमें से कोई भी तरीका प्रभावी साबित नहीं हुआ। सबसे सफल प्रयास में भी मात्र 6% की कमी देखी गई, जबकि प्रोफाइल छिपाने वाले प्रयोग में विभाजन और बढ़ गया और चरमपंथी पोस्ट को ज्यादा ध्यान मिला।

ये भी पढ़ें: कभी अमेरिका के 85 फीसदी कैमरा बाजार पर था कोडक का कब्जा, आज बंद होने के कगार पर खड़ी है कंपनी, जानिए क्या है कारण

क्या लोगों को बांट रहा सोशल मीडिया

अध्ययन का निष्कर्ष यह है कि सोशल मीडिया का ढांचा ही ऐसा है, जो इंसानों के बीच के विभाजन और पूर्वाग्रह को बढ़ावा देता है। यह एक ऐसे आईने की तरह है, जो हमारी तस्वीर दिखाता है, लेकिन सबसे विकृत रूप में।